在如今的数码世界中,人工智能芯片(AI Chips)已经成为驱动科技进步的核心力量。随着人工智能(AI)技术的广泛应用,从智能手机、智能家居到自动驾驶汽车,几乎所有的高科技产品都在依赖AI芯片进行高效运算。今天我们将围绕人工智能芯片展开讨论,深入探讨其工作原理、应用场景及其未来发展的重要趋势。

什么是人工智能芯片?

人工智能芯片,顾名思义,是专门为处理AI任务而设计的处理器。这些芯片与传统的中央处理器(CPU)或图形处理器(GPU)有所不同,它们专门针对机器学习算法进行优化,能够以更高效的方式处理大量的并行计算任务。

AI芯片的出现源于传统芯片架构无法满足AI应用对算力的极高要求。人工智能算法(例如深度学习)通常需要大量矩阵运算和并行处理,这使得传统芯片在执行这些任务时效率低下。而AI芯片通过硬件级别的优化,可以在功耗较低的情况下实现高效的AI推理和训练。

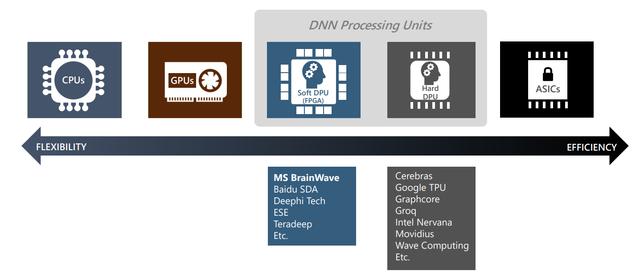

AI芯片的主要类型

GPU(图形处理器)

最早在AI领域崭露头角的芯片是图形处理器(GPU),它们最初设计用于处理复杂的图像和图形渲染任务。由于GPU能够进行大规模并行计算,因此它们非常适合深度学习中的矩阵乘法等操作,成为早期AI训练的核心硬件。NVIDIA是这一领域的领军企业,尤其是其开发的CUDA编程框架,推动了GPU在AI领域的广泛应用。TPU(张量处理器)

Google开发的TPU是针对深度学习任务专门设计的硬件加速器。与通用的GPU相比,TPU更加专注于神经网络的加速,特别是在推理阶段。TPU的核心优化对象是张量运算(Tensor Operations),因此在处理AI推理任务时,它的能效表现优于传统的GPU。Google目前在其云服务中广泛使用TPU来加速AI计算。FPGA(现场可编程门阵列)

FPGA是一种可以通过硬件编程实现特定功能的芯片。与GPU和TPU不同,FPGA的灵活性使其能够根据不同AI模型进行定制化优化。它的优势在于可以在不同任务之间进行快速切换,因此在需要处理多样化AI任务的场景中具有较大优势。目前,包括微软在内的公司,已经在云端使用FPGA来加速AI推理任务。ASIC(专用集成电路)

ASIC芯片是为某个特定任务设计的集成电路,它的设计完全围绕特定的AI模型进行,因此能够在功耗和性能之间达到最佳平衡。虽然ASIC的设计和生产成本较高,但其高效的计算性能使得它成为大规模AI推理的理想选择。在边缘计算、自动驾驶等需要低功耗、高效能的领域,ASIC芯片的应用正在逐渐增多。

AI芯片的工作原理

人工智能芯片的核心工作原理围绕并行计算展开。无论是GPU、TPU还是ASIC,它们的架构设计都针对神经网络的特点进行了专门优化。神经网络的训练和推理过程中涉及大量的矩阵乘法和加法运算,尤其是在深度学习中,数据需要通过多个神经元层进行逐层计算。

AI芯片通过增加处理单元的数量来提高并行处理能力。例如,GPU拥有数千个小型处理核心,这使得它们可以同时处理大量的计算任务。类似地,TPU等专用AI芯片通过硬件级别的矩阵加速器大幅提升了矩阵运算效率,从而加速了AI模型的训练和推理过程。

AI芯片的应用场景

智能手机与智能设备

随着AI在移动设备中的普及,智能手机已经成为AI芯片的重要应用场景之一。现代高端智能手机中内置的AI处理器能够进行图像识别、语音识别、增强现实(AR)等任务。例如,苹果的A系列芯片中集成的神经引擎(Neural Engine),能够处理机器学习任务,如照片优化、面部识别等。通过AI芯片的计算能力,智能设备能够实现更加智能化的用户体验。自动驾驶汽车

自动驾驶汽车是对AI芯片算力需求最为严苛的领域之一。为了确保车辆能够安全行驶,自动驾驶系统需要实时处理大量的传感器数据,并快速做出决策。AI芯片通过快速处理摄像头、雷达、LiDAR等设备的输入数据,生成精确的环境地图,帮助车辆避障、规划行驶路线。特斯拉的FSD(Full Self-Driving)芯片就是一个典型的例子,它通过专用硬件加速AI推理任务,实现了车辆的自动驾驶功能。数据中心与云计算

云端AI服务正在成为许多企业部署AI应用的主要方式,而AI芯片则是这些服务背后的核心硬件支持。通过在数据中心中部署大量的AI芯片,云服务提供商能够为客户提供高效的AI模型训练和推理服务。Amazon、Google、Microsoft等公司都在其云平台中引入了AI芯片,以满足日益增长的AI计算需求。边缘计算与物联网(IoT)

随着物联网设备的广泛应用,边缘计算对AI芯片的需求也越来越大。边缘计算指的是在接近数据源的地方处理数据,以减少传输延迟和带宽需求。在无人机、智能摄像头等边缘设备中,AI芯片可以帮助设备进行本地化的数据处理与分析,减少对云端计算的依赖。这种应用在需要实时响应的场景中尤为重要,例如安防监控、智能家居控制等。

AI芯片的未来发展趋势

多样化AI芯片的普及

随着AI应用场景的多样化,AI芯片的种类和功能将继续细化。例如,随着边缘计算的快速发展,低功耗、高效能的边缘AI芯片将成为下一轮技术竞争的焦点。未来,AI芯片将不仅在云端发挥作用,还将在终端设备中实现智能化计算,从而推动物联网和智能家居的进一步普及。量子计算与AI的结合

随着量子计算技术的进步,未来可能会出现将量子计算与AI相结合的芯片架构。量子计算的并行处理能力有望大幅提升AI算法的运行效率,尤其是在复杂数据处理任务中。这一领域虽然仍处于早期研究阶段,但已经被认为是AI芯片发展的一个重要方向。节能型AI芯片的研发

随着AI应用的广泛推广,AI芯片的能耗问题也逐渐引起了关注。未来,如何在保证计算性能的同时降低功耗,将成为AI芯片设计中的一个重要课题。特别是在自动驾驶和物联网等依赖电池供电的场景中,节能型AI芯片将是推动技术落地的关键。

人工智能芯片作为现代科技的“智慧引擎”,正在改变各个行业的面貌。从移动设备到自动驾驶,再到数据中心和边缘计算,AI芯片无处不在。随着技术的不断演进,我们可以预见,AI芯片将在未来的科技浪潮中扮演更加重要的角色,推动人类进入更加智能化的新时代。

#金秋图文激励赛#